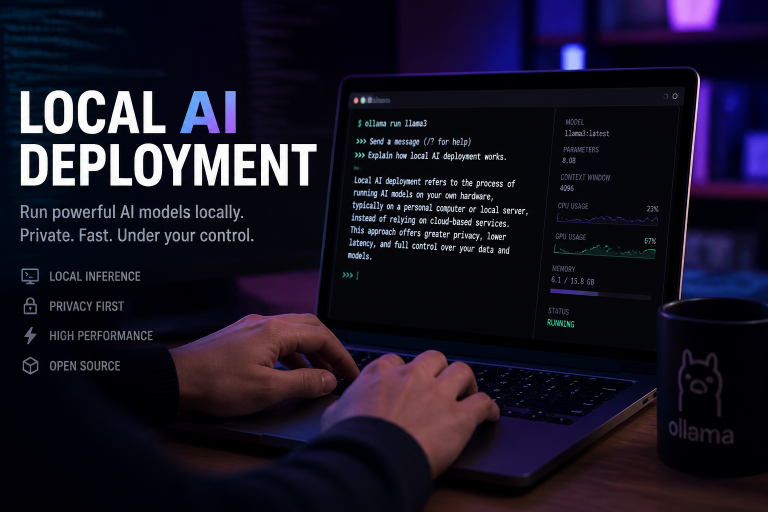

为什么选择DeepSeek本地部署?

红烁AI 培训,红烁 AI 中转站为您整理:DeepSeek是由深度求索公司推出的开源大语言模型,凭借媲美GPT-4的性能和完全开放的权重,迅速成为开发者和技术爱好者的首选。相比直接使用在线API,本地部署DeepSeek有三个核心优势:

- 数据隐私安全:所有对话数据留在本机,不上传任何服务器,适合处理敏感业务信息

- 零使用成本:一次部署,无限调用,无需按Token付费

- 离线可用:断网环境同样正常运行,不受服务器限流影响

本教程以目前最主流的 Ollama + DeepSeek 方案为核心,同时介绍 LM Studio 图形化方案,覆盖从零开始的完整安装使用流程。

部署前的环境要求

在开始DeepSeek本地部署之前,先确认你的硬件是否满足最低要求。模型参数量越大,对内存和显存的需求越高。

硬件配置参考

- DeepSeek-R1 1.5B:内存 8GB 即可运行,适合入门体验,CPU也能跑

- DeepSeek-R1 7B:推荐 16GB 内存或 8GB 显存,日常使用的最佳平衡点

- DeepSeek-R1 14B:推荐 32GB 内存或 16GB 显存,回答质量明显提升

- DeepSeek-R1 70B:需要 64GB 以上内存或多卡显存,适合专业用途

软件环境要求

- 操作系统:Windows 10/11、macOS 12+、Ubuntu 20.04+

- 磁盘空间:根据模型大小预留 5GB~40GB 可用空间

- GPU驱动(可选):NVIDIA显卡需安装 CUDA 11.8+,可大幅提升推理速度

方案一:使用 Ollama 部署 DeepSeek(推荐)

Ollama 是目前最简单的本地大模型运行工具,支持一条命令完成模型下载和启动,是DeepSeek本地部署的首选方案。

第一步:安装 Ollama

访问 ollama.com 官网,根据你的操作系统下载对应安装包:

- macOS:下载 .dmg 文件,拖入应用程序文件夹即完成安装

- Windows:下载 OllamaSetup.exe,双击运行安装向导

- Linux:在终端执行以下命令一键安装

curl -fsSL https://ollama.com/install.sh | sh安装完成后,在终端输入 ollama --version,看到版本号即表示安装成功。

第二步:下载并运行 DeepSeek 模型

Ollama 安装完成后,一条命令即可完成模型下载和启动。以 DeepSeek-R1 7B 为例:

ollama run deepseek-r1:7bOllama 会自动从官方仓库拉取模型文件(约4.7GB),下载完成后直接进入对话界面。你也可以根据硬件选择其他版本:

ollama run deepseek-r1:1.5b— 轻量版,适合低配设备ollama run deepseek-r1:14b— 均衡版,推荐有16GB内存的用户ollama run deepseek-r1:32b— 高性能版,需要32GB以上内存

第三步:通过 API 调用 DeepSeek

Ollama 启动后会在本地开放 http://localhost:11434 的 REST API,兼容 OpenAI 接口格式,方便集成到自己的应用中:

curl http://localhost:11434/api/chat -d '{

"model": "deepseek-r1:7b",

"messages": [

{ "role": "user", "content": "用Python写一个快速排序算法" }

]

}'方案二:使用 LM Studio 图形化部署

如果你不习惯命令行操作,LM Studio 提供了完整的图形界面,是DeepSeek本地安装使用的另一个好选择。

安装与配置步骤

- 访问 lmstudio.ai 下载对应系统的安装包并完成安装

- 打开 LM Studio,在搜索栏输入 deepseek,选择合适的量化版本下载

- 下载完成后点击 Load Model 加载模型

- 切换到 Chat 标签页,即可开始对话

- 在 Local Server 标签页可开启本地API服务,供其他应用调用

LM Studio 支持 GGUF 格式的量化模型,推荐选择 Q4_K_M 量化版本,在模型质量和内存占用之间取得最佳平衡。

配合 Open WebUI 打造私有 ChatGPT 界面

Ollama 默认只有命令行界面,搭配 Open WebUI 可以获得和 ChatGPT 一样的网页对话体验。确保已安装 Docker 后执行:

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main启动后访问 http://localhost:3000,注册账号后即可在浏览器中使用DeepSeek,支持多轮对话、历史记录、文件上传等功能。

常见问题 FAQ

Q1:下载模型速度很慢怎么办?

Ollama 默认从境外服务器拉取模型,速度可能较慢。可以配置国内镜像源,或使用代理工具加速下载。也可以先从 HuggingFace 或 ModelScope 手动下载 GGUF 格式文件,再通过 ollama create 命令导入本地。

Q2:运行时提示内存不足怎么解决?

优先选择更小参数量的模型版本,或选择量化程度更高的版本(如 Q2_K)。关闭其他占用内存的程序也有帮助。如果是显存不足,可以在 Ollama 中设置 OLLAMA_NUM_GPU=0 强制使用CPU运行。

Q3:CPU 和 GPU 运行速度差多少?

差距非常显著。以7B模型为例,NVIDIA RTX 3080 显卡每秒可生成约 40-60 个Token,而纯CPU(i7-12代)只有约 5-10 个Token/秒。有独立显卡的用户强烈建议启用GPU加速。

Q4:如何让 DeepSeek 支持中文对话?

DeepSeek 原生支持中文,无需额外配置。直接用中文提问即可获得中文回答。如果回答出现乱码,检查终端的字符编码是否为 UTF-8。

Q5:本地部署的 DeepSeek 和在线版有什么区别?

本地部署使用的是开源权重版本,与官网在线版的闭源商业模型存在一定差距,尤其在最新知识截止日期和某些推理任务上。但对于日常编程辅助、文档处理、知识问答等场景,本地版完全够用。

总结

DeepSeek本地部署并不复杂,借助 Ollama 工具,整个安装使用流程可以在30分钟内完成。核心步骤就三步:安装Ollama、执行 ollama run 命令、开始对话。根据自己的硬件选择合适的模型版本是关键,7B量化版是大多数普通用户的最佳起点。搭配 Open WebUI 后,你将拥有一个完全私有、零成本、可离线使用的个人AI助手,数据安全完全掌握在自己手中。

想了解更多AI工具和技巧?欢迎访问红烁AI 培训,红烁 AI 中转站,获取最新AI资讯和实用教程。