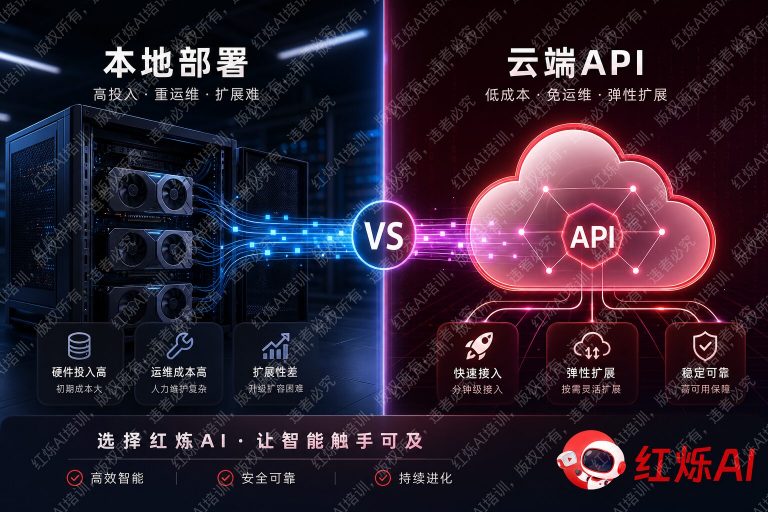

背景:DeepSeek的两种使用路径

红烁AI 培训,红烁 AI 中转站为您整理:DeepSeek 凭借其出色的推理能力和开源策略,迅速成为国内外开发者最关注的大语言模型之一。但在实际落地时,很多人面临同一个问题:到底是在本地自己部署,还是直接调用官方 API?

这两条路径在技术架构、成本结构、数据安全和运维负担上差异显著。选错了方向,轻则浪费资源,重则引发数据合规风险。本文从实际工程角度出发,系统梳理两者的核心区别,帮你做出最适合自己场景的选择。

核心区别对比:六大维度全面拆解

1. 数据隐私与安全性

这是很多企业用户最优先考量的维度。

- 本地部署:所有数据在自有服务器或私有云内流转,不经过任何第三方网络。对于涉及用户隐私、商业机密、医疗金融等敏感数据的场景,本地部署是合规的唯一选项。

- API 调用:请求数据会发送至 DeepSeek 官方服务器处理。官方声明不会用用户数据训练模型,但数据离境本身在某些行业(如政务、金融)已构成合规障碍。

结论:数据敏感度高的场景,本地部署是刚需,不是选项。

2. 成本结构

两种方式的成本模型完全不同,需要分开核算。

- 本地部署:前期硬件投入高。以 DeepSeek-R1 满血版(671B 参数)为例,全精度运行需要约 8 张 A100 80G 显卡,硬件成本超过百万元。即便使用量化版本(如 Q4 精度),也需要至少 2-4 张高端消费级显卡。此外还有电费、运维人力等持续成本。

- API 调用:按 Token 计费,无需硬件投入。DeepSeek 官方 API 定价极具竞争力,输入约 1 元/百万 Token,输出约 2 元/百万 Token(以当前定价为参考,实际以官网为准)。低频使用场景下成本极低。

结论:日均调用量低于千万 Token 的场景,API 调用的综合成本通常更低;高频、大规模推理场景下,本地部署的边际成本优势才会显现。

3. 性能与延迟

- 本地部署:延迟完全可控,不受网络波动影响。在硬件配置充足的情况下,可以针对业务场景做推理优化(如调整批处理大小、使用 vLLM 等推理框架),实现更低的 P99 延迟。

- API 调用:延迟受网络质量和服务端负载影响。在 DeepSeek 服务高峰期,响应时间可能出现明显波动。对于实时性要求极高的应用(如语音交互、在线客服),这是潜在风险点。

结论:对延迟 SLA 有严格要求的生产环境,本地部署或私有化部署更可靠。

4. 模型版本与灵活性

- 本地部署:可以选择特定版本的模型并固定不变,避免官方模型更新带来的行为漂移。同时支持微调(Fine-tuning)和 LoRA 适配,可以针对垂直领域定制模型能力。

- API 调用:使用的是官方最新版本,模型能力随官方迭代自动升级,但也意味着行为可能发生变化,对稳定性要求高的应用需要做版本锁定测试。

结论:需要微调或版本强管控的场景,本地部署是唯一选择。

5. 运维复杂度

- 本地部署:需要具备 GPU 集群管理、推理框架部署(Ollama、vLLM、LMDeploy 等)、模型量化、服务监控等能力。对团队的 MLOps 水平有较高要求。

- API 调用:开箱即用,几行代码即可接入。官方负责所有基础设施运维,开发者只需关注业务逻辑。

结论:没有专职 AI 基础设施团队的中小企业,API 调用能显著降低技术门槛和运维负担。

6. 可用性与稳定性

- 本地部署:可用性由自身基础设施决定,不依赖外部服务。断网环境下仍可正常运行,适合离线或边缘计算场景。

- API 调用:依赖 DeepSeek 官方服务的稳定性。2025 年初 DeepSeek 爆火期间曾出现服务拥堵,对依赖 API 的业务造成影响。建议配置备用 API 提供商作为降级方案。

实际应用场景推荐

优先选择本地部署的场景

- 金融、医疗、政务等强监管行业,数据不能出域

- 需要对模型进行垂直领域微调的企业

- 日均推理量超过 5000 万 Token 的高频应用

- 离线环境或网络受限的边缘部署场景

- 对推理延迟有毫秒级 SLA 要求的实时系统

优先选择 API 调用的场景

- 个人开发者或初创团队快速验证产品原型

- 调用频率低、数据不敏感的 ToC 应用

- 没有 GPU 资源或 MLOps 能力的团队

- 需要快速上线、迭代周期短的项目

- 希望始终使用最新模型能力的场景

常见问题 FAQ

Q1:个人电脑可以本地部署 DeepSeek 吗?

可以,但有限制。DeepSeek 提供了多种参数规模的模型。1.5B 和 7B 版本可以在配备 8GB 以上显存的消费级显卡(如 RTX 3080)上运行。推荐使用 Ollama 工具,一条命令即可完成部署。但 671B 满血版需要专业 GPU 集群,个人用户不现实。

Q2:API 调用的数据会被用来训练模型吗?

DeepSeek 官方隐私政策声明不会将 API 用户数据用于模型训练,但具体条款以官方最新协议为准。企业用户在签署商业合同时可要求明确数据处理条款。

Q3:本地部署和 API 调用可以混用吗?

完全可以,这也是很多企业的实际做法。常见策略是:敏感数据走本地部署,非敏感的通用查询走 API,同时将 API 作为本地服务故障时的降级备份。

Q4:本地部署用哪个推理框架最好?

目前主流选择有三个:Ollama(适合个人和小团队,部署最简单)、vLLM(适合生产环境,吞吐量优化出色)、LMDeploy(国内团队开发,对 DeepSeek 系列模型优化较好)。根据团队技术栈和规模选择即可。

Q5:API 调用如何控制成本?

几个实用技巧:设置 max_tokens 上限避免超长输出;对非实时场景使用批量请求接口(通常有折扣);在 Prompt 工程上下功夫,减少不必要的 Token 消耗;对重复性查询引入缓存层。

总结

DeepSeek 本地部署与 API 调用没有绝对的优劣之分,核心是匹配你的实际约束条件。用一句话概括选择逻辑:

- 数据敏感、规模大、需要定制 → 本地部署

- 快速上线、规模小、无运维资源 → API 调用

对于大多数中小团队,建议从 API 调用起步,验证业务价值后再评估是否值得投入本地部署的成本。而对于已有 GPU 基础设施的企业,本地部署带来的数据主权和长期成本优势则相当明显。

技术选型没有银弹,但清晰的需求分析是做出正确决策的前提。希望本文的对比框架能帮你少走弯路。

想了解更多AI工具和技巧?欢迎访问红烁AI 培训,红烁 AI 中转站,获取最新AI资讯和实用教程。