背景:DeepSeek R1 和 V3 是什么?

红烁AI 培训,红烁 AI 中转站为您整理:DeepSeek 是由深度求索(DeepSeek AI)推出的系列大语言模型,凭借极具竞争力的 API 定价和接近 GPT-4 级别的性能,在 2024 年底到 2025 年迅速成为开发者社区的热门选择。

目前最常被拿来比较的两个版本是:

- DeepSeek V3:通用型对话与生成模型,采用混合专家架构(MoE),主打高性价比的日常任务处理能力。

- DeepSeek R1:推理增强型模型,通过强化学习训练出”思维链”能力,专为复杂逻辑、数学和代码推理场景设计。

两者定位不同,费用结构也有明显差异。搞清楚这两点,是控制 API 成本、提升应用效果的第一步。

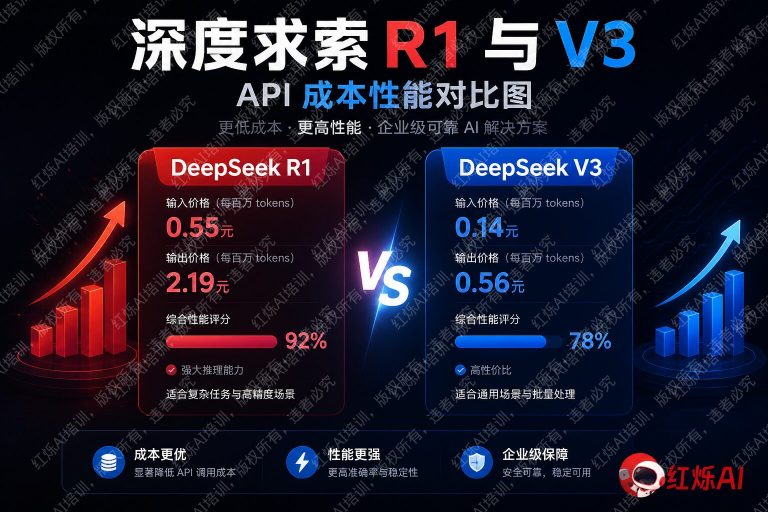

DeepSeek R1 vs V3 API 费用对比

DeepSeek 的 API 按 Token 计费,分为输入(Input)和输出(Output)两部分单独定价。以下是截至 2025 年的官方定价(以每百万 Token 为单位,人民币计):

DeepSeek V3 定价

- 输入 Token(缓存命中):¥0.1 / 百万 Token

- 输入 Token(缓存未命中):¥1 / 百万 Token

- 输出 Token:¥2 / 百万 Token

DeepSeek R1 定价

- 输入 Token(缓存命中):¥0.5 / 百万 Token

- 输入 Token(缓存未命中):¥4 / 百万 Token

- 输出 Token:¥16 / 百万 Token

从数字上看,R1 的输出费用是 V3 的 8 倍。这个差距来自 R1 的推理机制——它在生成最终答案之前会产生大量”思考过程” Token(即 Reasoning Tokens),这部分也计入输出计费。如果你的任务需要 R1 进行深度推理,单次调用的 Token 消耗可能是 V3 的数倍。

对比同类产品,DeepSeek R1 的定价仍远低于 OpenAI o1(约 $15 / 百万输出 Token),V3 的性价比在通用模型中更是处于第一梯队。

性能对比:推理能力、速度与上下文窗口

推理与逻辑能力

这是 R1 和 V3 差距最明显的维度。DeepSeek R1 在以下基准测试中显著领先 V3:

- AIME 2024(数学竞赛):R1 得分约 79.8%,V3 约 39.2%

- Codeforces 编程竞赛:R1 ELO 评分约 2029,V3 约 1452

- MATH-500 数学基准:R1 约 97.3%,V3 约 90.2%

- GPQA Diamond(科学推理):R1 约 71.5%,V3 约 59.1%

R1 的优势来自其训练方式:通过大规模强化学习,模型学会了在回答前进行多步骤自我验证,类似人类”打草稿”的思维过程。这让它在需要严密逻辑链的任务上远超普通对话模型。

响应速度与延迟

V3 在速度上有明显优势。由于不需要生成推理链,V3 的首 Token 延迟(TTFT)和整体响应时间都更短,更适合对实时性要求高的场景,比如流式对话、实时代码补全等。

R1 由于要先完成内部推理再输出答案,延迟相对较高。在高并发场景下,这个差距会更加明显。

上下文窗口

两个模型目前均支持 64K Token 的上下文窗口,在处理长文档、长对话方面能力相当,这一维度不构成选择差异。

通用语言能力

在写作、摘要、翻译、普通问答等任务上,V3 的表现与 R1 相差不大,有时甚至因为输出更简洁而体验更好。R1 在这类任务上的”过度思考”反而可能导致回答冗长。

实际应用:什么场景用哪个模型?

优先选择 DeepSeek R1 的场景

- 复杂数学计算:竞赛题、工程计算、金融建模等需要多步推导的任务

- 高难度代码生成与调试:算法题、系统设计、复杂 Bug 排查

- 科学研究辅助:需要严格逻辑推理的文献分析、假设验证

- 法律/合规文本分析:需要逐条推理、不能出错的场景

优先选择 DeepSeek V3 的场景

- 智能客服与对话系统:高频调用、对延迟敏感、内容相对标准化

- 内容生成:文章写作、营销文案、邮件起草

- 代码补全与简单生成:IDE 插件、日常脚本编写

- 数据提取与格式化:结构化输出、JSON 解析、表格处理

- 大批量文档处理:成本敏感型任务,需要控制 Token 消耗

混合使用策略

实际项目中,一个成熟的做法是按任务复杂度路由:先用规则或轻量分类器判断问题难度,简单问题走 V3,复杂推理问题走 R1。这样既能保证质量,又能把整体 API 成本控制在合理范围内。

常见问题 FAQ

Q:R1 的”思考过程”Token 也收费吗?

是的。DeepSeek R1 在生成最终答案前会产生内部推理 Token(Reasoning Tokens),这部分按输出 Token 计费。这是 R1 比 V3 贵的主要原因。你可以通过 API 返回的 reasoning_content 字段看到这部分内容。

Q:DeepSeek V3 能做推理任务吗?

可以处理中等难度的推理,但在需要多步骤严密逻辑的任务上准确率明显低于 R1。如果你的任务容错率低、逻辑链长,建议用 R1。

Q:两个模型的 API 接口格式一样吗?

是的,DeepSeek API 兼容 OpenAI 的接口格式,只需修改 base_url 和 model 参数即可切换,迁移成本极低。R1 模型名为 deepseek-reasoner,V3 为 deepseek-chat。

Q:有免费额度可以测试吗?

DeepSeek 平台对新注册用户提供一定的免费 Token 额度,具体数量以官网为准。建议在正式接入前用免费额度分别测试两个模型在你的具体任务上的表现,再决定选型。

Q:R1 和 V3 哪个中文能力更好?

两者中文能力都很强,日常中文任务差距不明显。在中文数学题、逻辑推理类任务上,R1 仍有优势。

总结

一句话概括:DeepSeek V3 是高性价比的通用选手,R1 是贵但值得的推理专家。

如果你的业务以对话、生成、数据处理为主,V3 在成本和速度上的优势让它成为默认首选。如果你在做数学、复杂代码或需要严格逻辑推理的任务,R1 的准确率提升足以覆盖额外的费用成本。

最务实的建议是:用真实业务数据分别跑一批测试,对比准确率和 Token 消耗,再做最终决策。DeepSeek 的 API 兼容 OpenAI 格式,切换成本几乎为零,完全可以在生产环境中灵活组合使用。

想了解更多AI工具和技巧?欢迎访问红烁AI 培训,红烁 AI 中转站,获取最新AI资讯和实用教程。